Il 12 giugno, la Commissione cultura della Camera dei deputati ha svolto l’audizione informale di Stefano Fantoni e Roberto Torrini, (presidente e direttore ANVUR), sulle problematiche concernenti l’abilitazione scientifica nazionale (ASN) e il sistema AVA. Oltre al video, pubblichiamo una trascrizione dei passaggi salienti in due post distinti, dedicati ad ASN e AVA. Per l’ASN, chi ne ha vissuto sulla propria pelle le farraginose vicende, fatica a riconoscersi nel quadro oleografico proposto da Fantoni che, oltre ad esaltarne le virtù meritocratiche e anti-baronali, mette in guardia dall’introdurre cambiamenti sostanziali. Il caos normativo ed il balletto delle mediane e degli indicatori è miracolosamente svanito per lasciare il posto ad un idilliaco quadretto ad uso e consumo dei deputati della Commissione cultura. Tuttavia, l’aggiornamento dell’audizione al 19 giugno, ci permette di analizzare e commentare questa apologia anvuriana, non senza formulare qualche domanda scomoda.

Premessa di Fantoni (Presidente ANVUR)

Noi sull’abilitazione, da molto tempo, non siamo più attori principali. Non è una cosa che ci riguarda più. Abbiamo fatto quel che ci era stato chiesto di fare e lì è finito il nostro compito. Tuttavia, naturalmente, è evidente che questo è un argomento che noi seguiamo e monitoriamo per capire anche ciò che è successo e di vedere anche di avere delle idee sul futuro.

[…]

Commento. Già in altra occasione, l’ANVUR ha mostrato la tendenza a scaricare sulle spalle altrui la responsabilità di scelte che erano sue (Abilitazioni e Mediane: “ANVUR non potuto fare altro”. Profumo sotto accusa?). Piuttosto che affermare “Abbiamo fatto quel che ci era stato chiesto di fare“, sarebbe più corretto dire che al momento di emanare i decreti che regolavano l’abilitazione scientifica il Ministro Profumo ha fatto quel che l’ANVUR gli aveva chiesto di fare. L’ANVUR è pertanto un attore a pieno titolo, avendo suggerito l’uso delle mediane, avendone cambiato la definizione in corso d’opera, come nel caso dell’indice h-contemporaneo, e avendole calcolate, senza aver mai reso note le distribuzioni. Avendo suggerito l’uso di indicatori inaffidabili e instabili, l’ANVUR è anche pienamente responsabile delle difficoltà incontrate dal MIUR e dal CINECA nell’attribuire valori certi agli indicatori dei candidati come pure dei ritardi e dei ricorsi che ciò ha comportato.

Io ho messo al lavoro un gruppetto dei nostri dell’ANVUR per fare un’analisi di quelli che sono i risultati che emergono da quelle che sono state le abilitazioni, che sono sostanzialmente finite dal punto di vista delle commissioni.

Vorrei raccontarvi le deduzioni di questi risultati che abbiamo ottenuto, lasciando a chi deve interpretare di fare le interpretazioni del caso.

Ho piacere di farvelo, perché dall’analisi che noi abbiamo fatto risulta una pittura che è meno critica da quello che si è letto nella stampa o che qualcuno veicola.

[…]

Io ho tutto un fascicolo che non vi ho lasciato perché è fatto di tabelle e di numeri, ma posso darvi che … invece vi parlerò di alcune risultanze: sintetizzerò quattro punti principali che emergono da questa analisi.

[…]

Commento. I dati VQR non avrebbero dovuto essere usati a fini individuali. Ora servono anche a giustificare i risultati ASN. Dati che non sono pubblici sono utilizzati per proporre statistiche che nessuno può controllare (i voti VQR individuali non sono pubblici). Se il Presidente e il Direttore di un’agenzia ministeriale (sì ministeriale, vigilata dal MIUR) usano questi dati per giustificare le proprie scelte di fronte ad una commissione parlamentare, è quanto mai opportuno che tutti i dati – nella forma voto VQR + tripletta di indicatori ASN – vengano resi pubblici (previo oscuramento di cognomi e settori scientifici).

Domanda a Fantoni. In che data l’ANVUR pubblicherà questi dati – previa anonimizzazione – sul suo sito?

1. I risultati ASN mostrano che le mediane hanno funzionato

Le commissioni hanno in larga parte fatto esplicito o implicito ricorso al parametro di impatto scientifico che prevedeva il superamento del valore mediano di alcuni indicatori.

Commento: Nei settori “bibliometrici” la prima mediana non è un parametro di impatto scientifico, ma una misura di produttività scientifica (numero di articoli negli ultimi dieci anni). Nei settori “non bibliometrici”, nessuna delle tre mediane rappresenta una misura di impatto scientifico, ma sono solo il numero di pubblicazioni appartenenti a determinate tipologie (articoli, monografie, articoli in riviste di fascia A).

Voi ricorderete che, al di là di quello che il bando aveva scritto, però c’era stata una lettera dell’allora ministro Profumo in cui in sostanza lasciava più mano libera alle commissioni di quanto il bando non dicesse.

Quello che e successo è la cosa seguente. Su 100 candidati all’abilitazione, circa il 50% è stato abilitato con la verifica e il rispetto del superamento delle mediane e solo il 6% di questi candidati è stato abilitato pur non superando le mediane. Quindi il discostamento netto dalle mediane è avvenuto per una percentuale molto bassa, poi alla fine delle commissioni. Fra l’altro, questi casi, se uno va vedere, si concentrano su pochissime commissioni, direi quattro, addirittura, tanto per esser più precisi.

Un ulteriore 27,4%, pur superando le mediane, non è stato abilitato, in quanto le commissioni hanno voluto di più delle mediane. Hanno richiesto un valore maggiore e questo è avvenuto per il 27,4%.

Il 17,8 % di candidati non è stato abilitato anche in base al fatto che le mediane non le superava.

Quindi, se noi andiamo a vedere la congruenza con le mediane, questa strettamente sale a circa il 66%, ma allargando,.includendo anche il 27% di chi ha voluto di più delle mediane – che era congruo col bando – si arriva a valori del 94%.Quindi, prima informazione: le commissioni hanno considerato i filtri e gli indicatori che erano stati dati come uno strumento di analisi importante, perché questi sono i risultati. Dopo di che, nel bene o nel male, ma loro le hanno giudicate così.

Commento. Per quanto la lettera circolare del Ministro Profumo contemplasse la possibilità di derogare all’uso rigido delle mediane, non lasciava “mano libera”, ma subordinava la deroga a precise condizioni

le commissioni […] possono attribuire l’abilitazione a candidati che, pur non avendo superato le mediane prescritte, siano valutati dalla commissione con un giudizio di merito estremamente positivo. Resta fermo che ogni decisione della commissione, relativamente a quanto precede, dovrà essere rigorosamente motivata secondo quanto previsto dall’articolo 6, comma 5, del citato decreto […] sia in sede di predeterminazione dei criteri che di giudizio finale.

La deroga andava “rigorosamente motivata” sia in sede di predeterminazione dei criteri che di giudizio finale. Le statistiche riportate da Fantoni vanno pertanto interpretate con la massima cautela, vista la doppia condizione che limitava la promozione di candidati che non superassero le mediane prescritte. Piuttosto, il fatto che il 25,2% dei candidati “submediani” sia stato comunque abilitato (su un totale di 6%+17,8% = 23,8% di candidati submediani, il 6% di abilitati rispetto al totale dei candidati corrisponde a 6/23,8 = 25,2%) mostra che, nonostante la pressione esercitata dai regolamenti sulle commissioni, in diversi casi si sia ritenuto necessario prescindere da valutazioni meramente quantitative. È pure degno di nota che il 36,0% dei candidati che superavano la mediana non sia stato abilitato (su un totale di 27,4%+48,8% = 76,2% di candidati supermediani, il 27,4% di abilitati rispetto al totale dei candidati corrisponde a 27,4/76,2 = 36,0%). Gli indicatori hanno avuto pertanto un valore predittivo limitato, mentre le difficoltà nel loro calcolo hanno comportato:

- ritardi di mesi nei lavori delle commissioni;

- errori che hanno alimentato il contenzioso;

- problemi di trasparenza, dato che le difficoltà di calcolo hanno costretto molti candidati a delle vere e proprie “scommesse” con il rischio del tutto reale di essere bocciati e dover saltare due anni a causa dell’incertezza nel calcolo dei propri indicatori.

Domanda per Fantoni: A fronte di una percentuale del 36% di supermediani non abilitati e del 25,2% di submediani abilitati (nonostante le restrizioni regolamentari), vale la pena di mantenere il farraginoso sistema delle mediane? E qualora si intenda persistere, dati gli innegabili problemi legati ai dati di partenza (una base di dati che fa acqua da tutte le parti), quali sono i piani a breve, medio e lungo termine per porvi rimedio?

2. I risultati ASN sono convalidati dai voti VQR

Il secondo punto ha a che fare con un esercizio che noi abbiamo fatto incrociando i risultati dell’abilitazione con quelli della VQR – che non è completamente proprio, perché la valutazione della ricerca aveva criteri diversi, ma, insomma, un’idea uno se la fa.

Questo incrocio di dati mostra che ben il 70,2% degli abilitati a professore ordinario ha ricevuto dalla VQR un punteggio ohe è un massimo [pari a uno, NdR] o 0,8., cioè, più del 70% di questi abilitati so’ bravi – non c’è niente da fare – anche dalla [valutazione della NdR] ricerca risulta che sono bravi. Io credo che questo vada detto con chiarezza.

Per i professori associati, questa percentuale cala al 64,7% E quindi io direi che questi risultati stanno a dire che l’abilitazione si è rivelata efficace nell’identificare i candidati migliori, o quanto meno in larga percentuale.

Un ulteriore 26,5% si colloca, per quanto riguarda la VQR, tra 0,2 e 0,8, non valori altissimi ma nemmeno bassissimi

Mentre, invece, se noi andiamo a vedere sotto lo 0,2 come risultato della VQR, questo ricopre appena il 3,3 %.

Quindi, seconda informazione: sembra che l’’abilitazione ha svolto un ruolo rilevante nel selezionare i futuri docenti sulla base del merito scientifico perché questo è quello che viene fuori da questa analisi.

Commento: L’Anvur insiste nell’abitudine di confrontare insieme mele con pere, di confrontare un esercizio volto alla valutazione della qualità della ricerca delle strutture con indicatori sviluppati ad hoc e di dubbia robustezza, con un esercizio volto invece ad analizzare nel merito i singoli. Al solito, una volta che abbiamo i dati li utilizziamo a nostro piacere per qualsiasi esercizio (si veda per esempio l’uso dei dati VQR per valutare i collegi di dottorato). Come se non fosse mai stato detto che i dati non sarebbero stati utilizzati per valutare i singoli. Ma a parte la scorrettezza, è diverso l’oggetto sotto osservazione (singoli e non strutture), diverso l’arco temporale, diverso il tema osservato (l’intera attività dei singoli docenti e ricercatori e non solo la ricerca).

Domanda per Fantoni: A pag. 9 del Rapporto Finale della VQR è scritto

Last but not least, l’ANVUR sottolinea che i risultati della VQR non possono e non devono essere utilizzati per valutare i singoli soggetti.

Come mai il presidente dell’ANVUR per valutare gli esiti delle abilitazioni dei singoli ricercatori usa un metro di comparazione che nei documenti ufficiali dell’agenzia è dichiarato inutilizzabile per la valutazione dei singoli soggetti? Come spiega questo grave errore metodologico?

3. L’ASN ha aperto una possibilità di carriera ai non strutturati

Terza osservazione che abbiamo fatto: siamo andati a vedere la differenza tra strutturati e non strutturati. C’è circa un 50% di candidati non strutturati e un atro 50% di strutturati. Quindi, c’è stata una notevole partecipazione di non strutturati.

I non strutturati, vi ricordo, possono essere stati giovani non ancora inseriti a livello di ricercatori ,quindi assegnisti, giovani che non hanno un incarico anche nemmeno a tempo determinato in termini di ricercatori, possono esser scienziati e docenti stranieri, possono essere docenti e scienziati di enti ricerca o professionisti che hanno fatto domanda.

Quindi, larga partecipazione di queste figure e anche largo successo di queste figure. Perché, se si va a vedere tra questi candidati che hanno ricevuto l’abilitazione a professore ordinario, il 19,3% proviene dai non strutturati e tale percentuale sale al 43,3% nel caso dei professori associati.

Questo è un risultato non scontato che mostra come l’abilitazione ha aperto la possibilità di una carriera accademica anche al personale [non] in organico, offrendo all’università ampia scelta per il futuro reclutamento. Un ingresso di questo tipo da personale non accademico non era mai avvenuto nel nostro paese. Questo credo che sia un fatto molo rilevante. Questa operazione ha aperto ai non strutturati. e quindi, diciamo, in qualche modo è andata contro le baronie – fatemelo dire da accademico – in maniera sostanziale rispetto a quello che era stato il passato.

Commento. Prima di attribuirsi titoli “antibaronali” è bene ricordare che il comma 4 dell’articolo 16 dellal. 240/2010 recita

4. Il conseguimento dell’abilitazione scientifica non costituisce titolo di idoneità né dà alcun diritto relativamente al reclutamento in ruolo o alla promozione presso un’università al di fuori delle procedure previste dall’articolo 18.

Ora la parola passa ai concorsi locali ed è in quella sede che avrà senso parlare di “ingresso”. Se si prolungherà il regime di limitazione del turn-over le opportunità offerte ai non strutturati saranno comunque limitate.

Domanda per Fantoni. Quanto è realistica la possibilità di una carriera accademica anche per il personale non in organico senza un’inversione di rotta delle politiche di finanziamento e di turn-over. Alla luce delle valutazioni raccolte in questi due anni e mezzo, che posizione tiene l’ANVUR? Quella di Sergio Benedetto che attribuiva all’ ANVUR il compito di additare sedi e corsi da chiudere, restringendo ulteriormente le opportunità di carriera per i giovani?

Tutte le università dovranno ripartire da zero. E quando la valutazione sarà conclusa, avremo la distinzione tra researching university e teaching university. Ad alcune si potrà dire: tu fai solo il corso di laurea triennale. E qualche sede dovrà essere chiusa. Ora rivedremo anche i corsi di dottorato, con criteri che porteranno a una diminuzione molto netta.

4. Alta percentuale di abilitati tra chi ha fatto domande multiple

Infine, l’ultima osservazione che volevo farvi è un’osservazione che fa parte del meccanismo delle varie domande. Molti candidati, nell’ordine di circa 4.000 – 3.600 – hanno fatto più domande per un totale di circa 10.000 domande. Questo fare molte domande, naturalmente, ha fatto sì che certi candidati sono stati giudicati da più commissioni, quindi eliminando anche un qualche rischio di un cattivo giudizio, come ovviamente ci sono pure stati – non e che io dica che sono tutte rose e fiori.

Se io vado a vedere in questo contenitore, mi accorgo che solo il 9,1% di questi candidati non ha ottenuto nemmeno un’abilitazione. Di questi candidati, questi hanno ricevuto al 91% – certamente una bocciatura, ovviamente – ma hanno avuto [anche] o una o più abilitazioni.

[…]

Le soglie assolute: un pericolo gravissimo

A conclusione di questa osservazione arriva anche un mio parere che io vi riverso. Io credo che, dato un certo sistema di valutazione o di reclutamento, un paese normale prima analizza i dati e poi decide che cosa fare.dopo. Perché poi le sirene del male sono sempre portatrici di mala informazione

Guardiamo bene i risultati. E Se li guardiamo con cura ci accorgeremo che il sistema non è stato così , …anzi – io ne ho fatti molti di concorsi universitari – mi pare che I risultati – ancorché se si va a vedere nei singoli casi ci sono cose che non mi piacciono – statisticamente sono andati piuttosto bene come prima volta che si fa questa operazione, così complessa così numerosa . Un’operazione di una complessità mai fatta nel nostro paese.

E devo dire che questo forse dovrebbe anche dare a voi, che siete tenuti a dare i vostri giudizi, e le vostre interpretazioni, dei moniti, degli warning, sui cambiamenti possibili. Io sento parlare di cambiamenti dell’abilitazione. Certamente, certe cose vanno riviste. Per esempio, nei casi delle materie umanistiche, certamente, ci sono delle cose che vanno riviste, non c’è il minimo dubbio.

Commento. Sì non c’è il minimo dubbio. Basti pensare che nelle liste delle riviste scientifiche era finito un po’ di tutto: su ROARS sono state segnalate non meno di 211 “riviste pazze” (qui, qui e qui)

Domanda per Fantoni: Come hanno fatto il Sole 24 Ore, il Mattino di Padova, Suinicoltura, Yacht Capital e l’Annuario del Liceo di Rovereto ad entrare nelle liste delle riviste scientifiche? Quali sono le procedure di assicurazione della qualità di ANVUR? Che garanzia abbiamo che non si ripetano altri esilaranti episodi?

Però, cambiamenti sostanziali, … però io starei molto attento.

Per esempio, sento parlare di mettere soglie assolute. Attenzione alle soglie assolute: sono un pericolo gravissimo. Perché le soglie assolute sono delle cose che naturalmente …

Prima di tutto, sono solo quantitative. Quindi chi vuole la qualità non dovrebbe fare le soglie assolute.

Commento. Una soglia numerica, che sia assoluta oppure calcolata come la mediana di una distribuzione, rimane comunque una soglia quantitativa. Non si è mai sentito dire che una mediana sia “qualitativa”. Fantoni deve avere ben poca stima dei suoi interlocutori per ricorrere ad un argomento così campato in aria.

Domanda per Fantoni. In che senso una mediana è una soglia qualitativa? (la domanda non serve a migliorare le abilitazioni, ma la redazione di Roars vorrebbe divertirsi un po’ sentendo la risposta)

Dopo di che, sono molto soggettive. Bisogna vedere chi le fa le soglie assolute.

Commento. Pure la scelta della mediana (il cinquantesimo percentile) è soggettiva dato che si potrebbe scegliere anche il 30-esimo o il 70-esimo percentile. Di nuovo, Fantoni mostra ben poca stima per le capacità logiche della Commissione cultura. Tra l’altro, le mediane calcolate dall’ANVUR non sono oggettive nemmeno come formula di calcolo. Infatti, l’ANVUR ha pubblicato una prima lista di mediane il 14 agosto (bibliometriche) e 24 agosto 2012 (non bibliometriche). Pochi giorni dopo, il 27 agosto 2012, l’ha ritrattata e ne ha pubblicata una nuova, adducendo giustificazioni poco convincenti. Nella seconda edizione del 27 agosto le mediane dei settori bibliometrici erano salite mentre quelle dei settori non bibliometrici erano scese. Inoltre, le mediane dovevano distribuirsi casualmente tra intere e frazionarie, ma c’erano intere aree (12, 13 e 8.a) in cui erano solo intere. Parafrasando Fantoni, verrebbe da dire che “le mediane sono molto soggettive: bisogna vedere chi le fa …“.

Domanda per Fantoni. Se le mediane ANVUR sono oggettive e non decise a tavolino, come è possibile che nelle aree 12, 13 e 8.a non ci sia nemmeno un settore concorsuale con mediana frazionaria?

E sono poco rispondenti alla diversità e alla disomogeneità di tutto il sistema universitario che è molto frastagliato e che anche all’interno di uno stesso concorso ha delle disomogeneità molto sensate.

Commento. L’argomento di Fantoni, si ritorce contro le mediane ANVUR. Quando un settore concorsuale è composto da due o più settori scientifici, le mediane ANVUR possono favorire ingiustamente il settore con la mediana più alta. A suo tempo, era stato mostrato che le contromisure dell’ANVUR (la cosiddetta “multimodalità”) sono inadeguate.

Quindi, io su questo do un parere di prestare tanta attenzione su questo, Perché, a fronte di un operazione che …

Io credo questi dati – insomma, li verificheremo ancora di più , insomma – io, io … penso che non possano che essere giudicati favorevolmente e devo dire anche a favore della nostra classe sia di giovani o di meno giovani che hanno preso l’abilitazione – a cui va riconosciuto il merito per il loro successo – ma anche tutto sommato per la classe accademica che mi pare si sia sottoposta a questo esame meritocratico in maniera molto sensata.Dopo di che è logico che sui singoli poi le cose cose vanno viste. […]

L’Onorevole Ghizzoni va a bersaglio

La seconda parte della seduta è presieduta dall’On Ghizzoni che è anche l’ultimo membro della commissione cultura a formulare le sue domande. Vale la pena di citare la sua domanda sugli errori delle banche dati e sulla “veridicità dei numeri”, che, come vedremo, sembra mettere in imbarazzo Fantoni:

Ci sono elementi di margine di errore che statisticamente sono inessenziali, ma sulla carriera di una persona pesano tanto. Per esempio, gli errori delle banche dati o il fatto che ai candidati non sia stato concesso conoscere le proprie valutazioni fornite dal CINECA, se non successivamente, non rappresenta un elemento, come dire, distorsivo, anche dei lavori della stessa commissione? Se lo andiamo a mettere dal punto di vista statistico, immagino che siano errori che forse non supereranno il 10%. Però hanno conseguenze per esempio sulla vita di queste persone, compiicate, come per esempio non potersi presentare per una tornata successiva dell’abilitazione È di dettaglio, ma non tanto.

Anche sulla veridicità assoluta dei numeri forse ci si potrebbe aprire un dibattito molto ampio.

Fantoni: “noi più trasparenti di tutto ciò che è avvenuto prima di noi”

All’intervento dell’On Ghizzoni, segue una breve replica di Fantoni, mentre Torrini chiude la seduta con una spiegazione dei rapporti dell’ANVUR nei confronti dell’ENQA. Da notare che Fantoni cita di sfuggita il problema degli errori negli indicatori almeno due volte (testo evienziato in viola). Evita però di entrare nel merito e preferisce citare le difficoltà delle classificazioni delle pubblicazioni scientfiche nelle aree umanistiche.

Io non sono la persona più adatta per rispondere sui ricorsi, perché non ce ne siamo occupati, però li conosco. Siamo a circa 1.000-1.100 ricorsi. Qualunque sia stato il numero, si sono sentiti numeri come 3.000. Sono fuori luogo, non sono 3000, sono 1000. 1000 ricorsi, che significa un ricorso su 50 candidati, cioè molto meno di prima di quando si facevano i concorsi in altro modo. Questa è la prima cosa.

Di questi 1.100 ricorsi, tenete conto che ci sono un numero di sospensioni [sic] che è tra le 100 e le 150, Abbiamo un numero di sospensioni che è estremamente piccolo, tanto per cominciare.

Commento. Fantoni omette di ricordare che le sospensive vanno rapportate non al numero totale di ricorsi pendenti, ma a quello dei ricorsi finora esaminati (su un totale non ufficialmente noto) che alla data del 6 giugno erano 270. Di queste domande cautelari gli accoglimenti sono circa 122 a fronte di 148 respingimenti. La percentuale di accoglimento si aggira pertanto sul 45%.

Sul fatto che la futura abilitazione debba tener conto delle difficoltà e degli errori della prima non c’e il minimo dubbio, anzi sono certamente d’accordo che ci sono siate delle disfunzioni di carattere anche tecnico di informazioni, eccetera.. Credo che in una seconda puntata, le cose non possano che migliorare e debbano migliorare e credo che questo possa essere possibile.

Faccio qui riferimento ad una cosa che mie è sembrata un po’ …

La seconda tornata di abilitazione è quella che dovrebbe essere in atto, anzi dovrebbe essere già finita, se non ci fossero state le proroghe. Quindi su quella non si discute, perché quella deve essere così come è.

Commento. Una proroga c’è stata ed un’altra è stata annunciata anche perchè nella seconda tornata, per calcolare gli astrusi (ed instabili) indicatori bibliometrici stabiliti dall’ANVUR sono occorsi più di sei mesi e mezzo a partire dalla chiusura del bando (31 ottobre 2013). Gli indicatori sono stati forniti alle commissioni dieci giorni prima del termine ultimo (31 maggio 2014) per la chiusura dei lavori (che era già il risultato di una proroga di 60 giorni). Il ritardo è stato persino peggiore di quello della prima tornata, nella quale gli indicatori erano stati resi disponibili a fine marzo 2013, dopo sei mesi dalla chiusura del bando (20 novembre 2012). Nella prima tornata, un gran numero di commissioni era anche stata costretta a riaprire i verbali perchè gli indicatori erano stati aggiornati dopo la conclusione dei lavori e l’invio dei verbali definitivi. Da ultimo, molti ricorsi al TAR si fondano sugli errori degli indicatori forniti ai commissari.

Domanda per Fantoni. Si parla di revisione di ASN ma non si parla affatto della revisione delle modalità di raccolta dei dati, della loro consistenza, della loro validazione. Se non si fanno passi avanti, non sarebbe meglio abbandonare quegli indicatori – proposti dall’ANVUR – che si sono rivelati una palla al piede dell’ASN, sia per i tempi che per il contenzioso giuridico?

Quindi la vera tornata da discutere è quella che viene dopo. E quella io credo che vada discussa. E io sono d’accordo, ovviamente, nel dire che la situazione non va stravolta, almeno fintanto che i numeri non diventano piccolissimi. Ad un certo punto i numeri diventeranno piccoli dei candidati e quel punto è chiaro che tutto il sistema va rivisto. Ma in questo momento io credo che sia giusto.

Quali sono state le debolezze che io ritengo maggiori, al di là di queste tecniche che diceva il presidente?

Certamente, nelle aree umanistiche c’è stata una certa difficoltà e io credo che si possa imparare molto da quello che è avvenuto, nel senso che forse certe caratterizzazioni di certi prodotti di ricerca vadano analizzati meglio. Ma credo che con quello che è venuto fuori dai suggerimenti delle società predette credo che questo sia assolutamente possibile fare e sta nelle corde del normale miglioramento di un processo che è cominciato adesso.I dati che vi ho dato, non è che non li abbiamo pubblicati per non di trasparenza. Credo che nessuno ci può accusare di non trasparenza. Anzi, ci hanno accusato di troppa trasparenza. Mi ricordo che alcuni giuristi famosi mi hanno detto «Guarda che non puoi vivere in una casa di vetro, quindi non devi essere troppo trasparente»

Noi siamo stati più trasparenti di tutto ciò che è avvenuto prima di noi nel sistema universitario. Quindi, questo tenetelo in conto, perché – scusate, ma questo è un merito che mi voglio dare – perché questo è stato uno dei nostri prerequisiti e sul quale non recedo anche se questo può cozzare a volte anche con la privacy, che naturalmente mette dei vincoli di fatto.

Commento. Non basta dire di essere “più trasparenti di tutto ciò che è avvenuto prima di noi” per essere trasparenti. Un primo passo è ottemperare ai regolamenti ministeriali pubblicando le informazioni che l’agenzia è tenuta a pubblicare.

Domanda per Fantoni. Il punto 4 dell’Allegato A del D.M. 76/2012 recita

Il calcolo delle distribuzioni degli indicatori e delle relative mediane è effettuato dall’ANVUR e pubblicato sul proprio sito web e su quello del Ministero.

Se la trasparenza è uno dei prerequisiti dell’ANVUR, perché non è stata resa pubblica la distribuzione degli indicatori usati per il calcolo delle mediane ASN?

Altre dimostrazioni della tanto vantata trasparenza, potrebbero riguardare le procedure di classificazione delle riviste in fasce di merito per i settori non bibliometrici.

Domanda per Fantoni. Rendere noti i verbali delle procedure di classificazione delle riviste in classi di merito sia per la VQR che per l’ASN?

Domanda per Fantoni. Rendere nota la lista delle “3.133 riviste, considerate non scientifiche”, menzionate nel documento La classificazione delle riviste nell’ambito dell’abilitazione nazionale.

È ora di rottamare la bibliometria fai-da-te

Tirando le somme dell’ intervento e della replica di Fantoni sull’abilitazione scientifica nazionale, il messaggio appare chiaro:

- le decisioni delle commissioni sarebbero risultate in buon accordo con il superamento o meno delle mediane (ma omette di osservare che, nonostante gli ostacoli procedurali le commissioni hanno ritenuto di abilitare il 25,2% di candidati submediani e di non abilitare il 36% di quelli supermediani);

- sono stati premiati i migliori, identificati come coloro che avevano buoni voti VQR (ma vista l’autonomia mostrata dalle commissioni rispetto agli indicatori voluti dall’ANVUR, l’argomento è debole, senza contare che l’ANVUR ha chiaramente dichiarato che la VQR è inutilizzabile per valutazioni individuali);

- l’abilitazione non è andata così male come scrivono i giornali (ma la percentuale di sospensive concesse andrebbe rapportata ai ricorsi effettivamente esaminati, non al totale quelli presentati);

- l’ANVUR ammette qualche problema nei settori umanistici dove qualche aggiustamento sarà necessario (ma non individua né i problemi specifici né le loro cause né come intenda porvi rimedio);

- Fantoni mette in guardia dall’abbandonare il criterio della “mediana” secondo il quale sono ritenuti inadeguati tutti i ricercatori i cui indici bibliometrici sono nella seconda metà della classifica nazionale;

- non viene fatto cenno né ai problemi degli indicatori citazionali usati nelle aree scientifiche (“scienze dure”) e se ne deduce che l’ANVUR continui a raccomandarne l’uso.

Se si eccettua l’intervento dell’On. Ghizzoni, è rimasto ai margini della discussione proprio uno degli argomenti centrali, ovvero l’utilizzabilità di misure bibliometriche (numero di lavori, variamente classificati, e numero di citazioni nella letteratura scientifica) ai fini della valutazione automatica dei ricercatori. Queste misure sono informazioni che, messe a disposizione di un valutatore esperto, possono fornire informazioni, anche preziose, senza però essere capaci, da sole, di fornire un quadro esauriente del valore scientifico di un candidato.

L’impraticabilità dell’uso normativo della bibliometria è facilmente comprensibile anche da parte dell’uomo della strada. Per fare un esempio, stilare una classifica degli scienziati in base alle citazioni e prendere decisioni solo in base a queste significa attribuire valenza normativa a indici di “celebrità” che non solo sono dipendono dai temi di ricerca (anche all’interno della medesima disciplina) ma che sono facilmente manipolabili.

In effetti, ci sono almeno tre aspetti su cui Fantoni dovrebbe fornire delle risposte.

A. Quali basi per l’uso normativo della bibliometria?

La comunità scientifica internazionale, diversi autorevoli comitati e società scientifiche internazionali e persino l’HEFCE inglese (che ha la responsabilità delle valutazione nazionale della ricerca), si sono pronunciati contro l’uso della bibliometria come strumento di valutazione automatica per il reclutamento e la promozione dei singoli scienziati:

- D.N. Arnold (past president of the Society for Industrial and Applied Mathematics)

http://www.siam.org/news/news.php?id=1663 - R.R. Ernst (Nobel prize in Chemistry)

http://www.chab.ethz.ch/personen/emeritus/rernst/publications - International Mathematical Union (IMU), International Council of Industrial and Applied Mathematics (ICIAM), and the Institute of Mathematical Statistics (IMS): Joint Committee on Quantitative Assessment of Research: Citation Statistics

http://www.iciam.org/QAR/CitationStatistics-FINAL.PDF - European Mathematical Society: Code of Practice

http://www.euro-math-soc.eu/system/files/COP-approved.pdf - European Physical Society: On the use of bibliometric indices during assessment

http://www.eps.org/news/94765/ - Institut de France, Académie des Sciences: Du Bon Usage de la Bibliometrie pour l’Évaluation Individuelle des Chercheurs”

http://www.academie-sciences.fr/activite/rapport/avis170111gb.pdf - DORA – San Francisco Declaration on Research Assessment, sottoscritta da più di 400 organizzazioni (comprese riviste come Science, Plos e PNAS) e 9.000 individui

http://am.ascb.org/dora/ - IEEE Board of Directors: Position Statement on “Appropriate Use of Bibliometric Indicators for the Assessment of Journals, Research Proposals, and Individuals”

https://www.roars.it/wp-content/uploads/2013/11/IEEE-Bibliometric-Statement.pdf - House of Commons, Science and Technology Committee: Peer review in scientific publications, Eighth Report of Session 2010–12, released: 28 July 2011.

http://www.publications.parliament.uk/pa/cm201012/cmselect/cmsctech/856/856.pdf - Higher Education Funding Council for England (HEFCE): Report on the pilot exercise to develop bibliometric indicators for the Research Excellence Framework , released: September 2009.

http://www.hefce.ac.uk/pubs/hefce/2009/09_39/

Domanda per Fantoni. Perché l’ANVUR in completa controtendenza rispetto agli standard scientifici e alle raccomandazioni internazionali continua a sostenere l’uso di metodologie bibliometriche non validate e, anzi, prive di qualsiasi base scientifica?

B. Analisi costi-benefici dell’uso normativo della bibliometria

È ben noto (per es.: Why Metrics Cannot Measure Research Quality: A Response to the HEFCE Consultation) che l’adozione a scopo normativo di metriche bibliometriche favorisce il conformismo accademico (conviene dedicarsi ai temi più “popolari”) e costituisce un forte incentivo a comportamenti opportunistici (incroci di coauthorship e di citazioni “di cortesia”) che invalidano le metriche e deteriorano gli standard etici della comunità accademica. Mentre nel Regno Unito, a valle di uno studio pilota, si è rinunciato ad usare valutazioni bibliometriche automatiche (No bibliometrics please, we’re British.), in altre nazioni meno caute stanno già emergendo comportamenti anche fraudolenti (Bibliometrics? Yes, please! We are Serbian (and Italian), Dopo i Serbi arrivano i Brasiliani. A quando gli Italiani?).

Domanda per Fantoni. L’ANVUR ha condotto un’indagine costi-benefici per quantificare i danni derivanti dai comportamenti opportunistici indotti dall’uso normativo della bibliometria?

C. Instabilità dei dati bibliometrici

Per loro natura, gli indicatori citazionali sono instabili, rendendo del tutto problematico il loro utilizzo, come dimostrato da un episodio di due anni fa. Il 24 agosto 2011, la Repubblica pubblica una notizia shock: dal 2008 al 2009 la produzione scientifica italiana era calata del 20% in un solo anno!

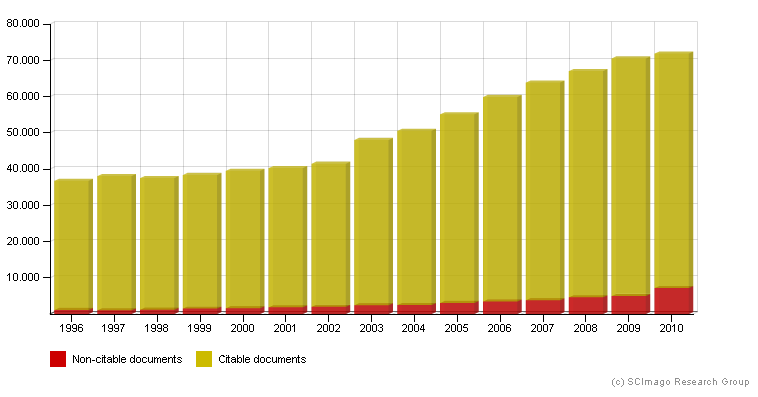

Il dato, proveniente da un articolo scientifico di Cinzia Daraio (una collaboratrice di uno dei membri del direttivo ANVUR, Andrea Bonaccorsi) era stato inoltrato alla redazione di Repubblica dall’ufficio stampa dell’ateneo di Bologna (vedi qui il commento del pro-rettore Dario Braga). Un esame più attento dell’articolo scientifico mostrava, però che la produzione scientifica italiana non era l’unica ad essere crollata. Infatti, dal 2008 al 2009, tutte le nazioni europee avevano visto una drammatica contrazione della loro produzione scientifica, come si può verificare dalla seguente figura tratta dall’articolo scientifico di C. Daraio e H. Moed.

Ma ad un esame ancora più attento, l’interrogazione dei database bibliometrici mostrava che non c’era traccia del crollo, ma anzi che la produzione scientifica dell’Italia (e delle altre nazioni europee) era in realtà aumentata.

Insomma, la notizia era del tutto priva di fondamento. Ma da dove provenivano i dati errati? La spiegazione, abbastanza semplice, era un fenomeno ben noto agli addetti ai lavori, tanto da essere citato a pagina 5-30 del rapporto Science and Engineering Indicators 2010 del National Science Board statunitense:

Previous editions reported data based on the year an article entered the database (tape year), not on the year it was published (publication year). NSF analysis has shown that, for the U.S. data, each new tape year file fails to capture from 10% to 11% of articles that will eventually be reported for the most current publication year; for some countries, the discrepancy is much larger. Here, data in the first section only (“S&E Article Output”) are reported by publication year through 2007, which contains virtually complete data for this and prior publication years.

Pertanto:

- C’è un ritardo di registrazione per cui l’ultimo anno disponibile nel database non comprende almeno il 10% degli articoli che a regime risulteranno pubblicati in quell’anno

- Il National Science Board nel suo report del 2010, non usa i dati 2008 e 2009 perché ritiene assestati solo i dati fino al 2007.

I dati diffusi da Repubblica, relativi al 2009 erano stati raccolti nel 2010 ed erano pertanto largamente incompleti. Da qui l’impressione, del tutto errata, di un calo della produzione scientifica. Da notare che, come specificato dal National Science Board (“for some countries, the discrepancy is much larger“) i ritardi di registrazione non sono distribuiti in modo uniforme neppure su scala aggregata. A maggior ragione, sarebbe del tutto azzardato usare dati bibiometrici degli ultimi due anni per la valutazione individuale dei ricercatori: le citazioni (passate!) di un singolo ricercatore possono letteralmente variare di settimana in settimana a causa dei ritardi con cui vengono registrate in database commerciale i cui scopi non sono mai stati di natura normativa.

L’infortunio di Repubblica fu smascherato in tempo reale, mentre era ancora aperta la discussione sull’introduzione delle “mediane” nella procedura di abilitazione scientifica. L’ANVUR era stato messo al corrente della vicenda nel corso di una tavola rotonda tenuta a Pisa (qui le slides). Ciò nonostante, l’agenzia non mutò la raccomandazione di valutare bibliometricamente i candidati e, anzi, fu introdotto un indicatore citazionale (indice h contemporaneo) che dà maggior importanza a pubblicazioni e citazioni recenti, ovvero le più instabili ed inaffidabili.

Domanda per Fantoni. In nome della trasparenza, nelle prossime tornate verrà consentito ai candidati di conoscere i valori dei propri indicatori bibliometrici e di chiederne la correzione in caso di dati incompleti o errati? In caso affermativo, è in grado di garantire che il numero di richieste di rettifica non sarà tale da paralizzare la procedura?

Link al video: http://webtv.camera.it/evento/6508

Il video non l’ho visto (né lo farò: va bene perder tempo, ma a tutto c’è un limite), ma dalla qualità sintattico-grammaticale che emerge dalle trascrizioni di “passaggi salienti” che avete fatto sembrerebbe che alla Camera sia stato oggetto di audizione un semianalfabeta.

Beh, forse è il caso di ascoltare l’audizione. Fantoni, che è toscano, in italiano parla bene.

E’ di Taranto, comunque.

Toscano sicuramente dai tempi del liceo.

Peccato che sia la vqr che l’asn contenessero lo stesso errore marchiano: il numero degli autori di un lavoro non contava nulla. Mi dispiace per Fantoni, ma non considerare il numero degli autori significa proprio favorire scuole e il gioco dei baroni…..

Peccato che questi signori dell’ anvur non arrivino a capirlo !

Elena!!!

finalmente qualcuno che sottolinea questo aspetto così importante!!! Scrivere da soli o in 10 non è proprio la stessa cosa!!!

Certo. Un lavoro con moltissime citazioni a singolo autore dovrebbe valere un pò di più.

Propongo un fattore correttivo notturno:

il reciproco della radice quadrata del numero di autori, cioè

1/sqrt(autori)

di modo che le “citazioni effettive” risultino date dalla formula

citazioni effettive = citazioni/sqrt(autori).

Esempio: se un lavoro ha 100 citazioni e 4 autori le citazioni effettive risultano

100/sqrt(4) = 100/2 = 50.

Va beh, forse si puo togliere la radice quadrata se si vogliono avvantaggiare ancora di piu’ i lavori a pochi autori.

Non per fare il bastian contrario: ma risulta difficile fare un lavoro scientifico sperimentale da soli… Prendere il numero di autori per dare un valore ad un articolo scientifico mi sembra francamente discutibile. Altra obiezione è che molte commissioni hanno considerato la posizione dell’abilitando tra i nomi degli articoli presentati…

Perché uno che scrive su nature come primo nome tra 20 dovrebbe essere penalizzato, rispetto per esempio ad uno che scrive da solo una review?

Un parametro simile favorirebbe indubbiamente chi scrive molte review, rispetto a chi fa studi sperimentali in collaborazione… mah!

Io infatti penso ai 2 settori di fisica teorica, o a quelli di matematica.

Se non ricordo male, nel INFM (che ora non c’e’ più, sigh) i teorici si distribuivano i fondi di ricerca con un un algoritmo dove il peso era

1 per lavori a 1 o 2 autori

0.75 per lavori a 3 autori

0.5 per lavori a 4 o più autori.

Molto umilmente, e se la redazione acconsente, mi permetto di segnalare un paper sui sistemi premiali che considerano o meno il numero di coautori http://dx.doi.org/10.1016/j.eap.2014.05.003

Molto sinteticamente, il risultato è che l’utilizzo della regola 1/n (con n=numero coautori) nel valutare/premiare i prodotti scientifici consente una migliore selezione tra individui (se la capacità individuale non è osservabile in altri modi). Il sistema non proporzionale, invece, incentivando le collaborazioni tra tutti i ricercatori produce un maggiore impegno da parte di tutti i ricercatori (bravi e meno bravi). Tutto dipende da ciò che si vuole ottenere.

Interessante! Il link ad un preprint open?

con piacere!

http://mpra.ub.uni-muenchen.de/27730/1/MPRA_paper_27730.pdf

grazie

Articolo interessante. La conclusione però è che ogni settore dovrebbe avere le sue regole peculiari non sempre sovrapponibili con quelle di altri settori anche in ambito bibliometrico.

Alcune regole proposte nei settori 06: tenere conto dei primi, secondi, penultimi ed ultimi nomi, o del fatto di essere corresponding author. Dare maggior peso ai lavori con <10 nomi. Dare maggior peso ai lavori con autori non del proprio settore concorsuale.

Rimane comunque complicato stabilire chi ha un curriculum "vero" o uno "gonfiato"…

“Rimane comunque complicato stabilire chi ha un curriculum “vero” o uno “gonfiato”…”

___________________

Non credo che esista sul mercato un algoritmo in grado di risolvere il problema senza intervento umano.

Io invece, siccome mi occupo in questo momento di narratività, me lo ascolterò e leggerò attentamente per vedere come viene plasmato il romanzo della asn (tenendo conto dei commenti che fate), infatti F. dice ‘racconterò’. Mi domando come poteva parlare senza avere un antagonista esperto che gli facesse le pulci; quando si ascolta un testimone si ascolta anche il controtestimone. E’ evidente che l’avrebbe raccontata come a lui conveniva, contando anche sulla estraneità alla materia della commissione, che invece da parte sua doveva presumere correttezza, completezza e buona fede. Ed è pure buono! Ma cosa c’entra la vqr con la asn? Ogni tanto sento una frase. Quanto allo stile (fausto_proietti) deve trattarsi di fenomeni tipici del parlato, ancorché colto, ma devo ascoltare con più attenzione. Ma mi domando anche che cosa ha capito la commissione. Ora inizia invece la storia dell’ava, incominciando dalle visite che sarebbero la cosa più normale e universale; anche l’ava è antibaronale ed è una apertura ai giovani, è utile per l’università di massa. Hanno bisogno di una corrazza antibaroni, gli avisti, ma se la sono procurata (risolino). Basta!

Spiegazione della differenza fra soglie quantitative (assolute) e qualitative (mediane). Nel caso delle prime, basta che tutti gli interessati corrano un po’ per pubblicare e prima o poi tutti si abilitano. Nel secondo la storia è più complicata:

ogni anno chi sta sotto la mediana si sveglia e sa che dovrà correre a pubblicare per superare la mediana

ogni anno chi sta sopra la mediana si sveglia e sa che dovrà correre a pubblicare per restare sopra la mediana.

In conclusione, non importa che tu stia sotto o sopra la mediana. Corri a pubblicare ogni minc***ta che ti viene in mente, o l’Anvur ti fot***à.

Avevo il proposito di non intervenire più, ma un pò di curiosità mi spinge a vedere ciò che succede in Italia…se non altro perché sto vedendo un numero crescente di ricercatori che fuggono dall’Italia e vengono qui in UK. Il prof. Fantonov dice che l’abilitazione é antibaronale? mi sembra che vi sia molta ipocrisia, poiché in interi settori – storico, sociologico, economico, giuridico – l’ ASN ha rappresentato proprio il regno dei baroni ed ha respinto persone molto quotate im ambito internazionale ma non gradite ai baroni-commissari (ricordo la lettera dei premi Nobel per storia economica, la lettera dei giuristi con formazione internazionale, etc..). Ho incrociato tante persone che, in questi settori, ringraziano espressamente “il cielo” per il fatto di..”fare parte di una scuola che mi ha permesso di ottenere l’abilitazione”. Abilitazione super-baronale, altro che anti-baronale…Nei Paesi anglosassoni ma non soltanto, non c’ è bisogno di appartenere a “scuole” per entrare; si deve essere valutati ed apprezzati dalla singola Università e basta. Ovviamente, chi ha da guadagnare dal sistema italiano così com’ è, lo difende. Ora prometto veramente che non disturberò più.

Sarebbe interessante sapere se i presenti hanno ritenuto soddisfacienti le risposte date da Fantoni.

[…] Fantoni però l’ASN non necessita di cambiamenti sostanziali (Fantoni alla Camera: l’ASN è meritocratica e contro le baronie, no a cambiamenti sostanziali – ROARS). Chissà se anche questa volta si nasconderanno poi dietro il loro ruolo […]

Ma già l’incipit nel quale Fantoni dichiara che l’ASN è una cosa che “non ci riguarda più, perché abbiamo fatto quello che ci è stato chiesto di fare” dice molte cose. E’ un tentativo maldestro di deresponsabilizzazione, perché anche se è vero che non sarà l’ANVUR ad essere chiamata direttamente in carica nelle procedure giudiziali ad esempio, esistono, esisterebbero dei principi deontologici da considerare.

Entrando più nello specifico delle argomentazioni:

– è sorprendente casomai che chi supera le mediane abbia tre pubblicazioni “di rilievo” (bisognerebbe entrare anche qui nel merito) nel periodo 2004-2010? Una coincidenza che prova che uno che pubblica piuttosto bene, effettivamente pubblica piuttosto bene? Incredibile. Only the brave – OTB, potrebbe essere un acronimo per un nuovo programma ANVUR per premiare solo i bravissimi (slogan: “se so’ bravi, so’ bravi”).

– il discorso sull’uso delle mediane: era previsto già per legge che la commissione potesse derogare all’uso degli indicatori, ma che la giustificazione in quel caso andasse ben supportata da giudizi più che lusinghieri: è plausibile allora che a volte si sia semplicemente verificata, più che l’apprezzamento critico degli indicatori, l’osservanza stretta della regola di legge del superamento di 2 mediane su 3 per certe commissioni piuttosto che per altre? Più che un discorso quindi di validità della regola, una sua più o meno ligia applicazione? Questo non significa mettere in discussione il valore della regola stessa, ma ha l’effetto, però, di creare ancor più discriminazioni fra candidati esaminati da commissioni diverse; il fatto poi di non aver abilitato chi le mediane le superava è ancora legato a fattori diversi: spesso, spessissimo, alla non congruenza con il SSD;

– 50% di non strutturati, assegnisti, dottorandi, ecc. abilitati sarebbe lo sfondamento delle barriere baronali, il superamento del fossato coi coccodrilli intorno ai castelli universitari con tanto di aggiramento delle colate di olio bollente? Peccato che il sole dell'”avvenire” riguardi spesso precari classe anni ’60 – ’70, che hanno tirato la carretta per dieci-vent’anni, prima ambendo ad un posto da ricercatore a TI e poi restando al palo dal 2008 per via del blocco totale dei concorsi; per fortuna poi è arrivata l’ASN e li ha abilitati, ora sono precari con un titolo, se poi entreranno questo non è responsabilità dell’ANVUR, ma si è detto e ridetto (“mica so’ tutte rose e fiori”);

– il parere che ci riversa (parole sue!), sull’uso dei valori assoluti che sarebbero ben peggio delle mediane perché solo quantitativi…e perché le mediane non sono grandezze quantitative? Non sono poi solo grandezze quantitative, ma tagliano fuori il 50% dei docenti italiani! Oltre ad essere quantitative, mal stimate, sono anche improbabili! Magari valori fissi, ma più bassi, di accesso, e calibrati sui settori, hanno più senso?!

Ma, s’è detto, non so’ mica tutte rose e fiori.

E le rose c’hanno le spine poi, peccato che l’ASN più che una rosa sembri un cactus.

ps. io sono contenta per i miei colleghi che comunque stanno andando avanti, che per me so’ bravi comunque e se lo meritavano, a prescindere dall’ASN.

Ho un dubbio sul discorso delle percentuali. Secondo me Fantoni, pur con un discorso molto contorto, si riferisce sempre alla stessa base di calcolo. Sommando 50% abilitati con mediane + 6 %abilitati senza mediane + 27,4 non abilitati con mediane + 17,8 non abilitati senza mediane = 101,8 dato che considerando qualche approissimazione delle cifre citate senza decimali potrebbe essere un 100%.

Facendo le percentuali delle percentuali, come interpretato dal commentatore non mi riesce a far tornare 100 la somma.

L’interpretazione delle percentuali di Fantoni (che sommano a 100) appare corretta. Le percentuali delle percentuali servono a valutare la frazione dei submediani che sono stati abilitati e la frazione dei supermediani non abilitati. Essendo percentuali su totali diversi (submediani e supermediani), è logico che non sommino a 100. Tuttavia, sono le percentuali che servono per capire cosa è accaduto: un quarto dei submediani è stato abilitato (e 3/4 non lo è stato), mentre più di un terzo dei supermediani non lo è stato (e meno dei due terzi sono stati abilitati). Di fronte a un submediano siamo tutt’altro che sicuri dell’esito (a meno che non fossero applicate rigidamente le mediane). Di fronte ad un supermediano, l’esito è ancora più incerto. Pensare che l’uso di soglie rigide ma più alte delle mediane spieghi la maggior parte delle bocciature dei supermediani mi sembra azzardato. Piuttosto, viene da pensare che sia stata applicata una buona dose di giudizio umano. Se le cose stanno così, non si vede perchè insistere nell’uso antiscientifico e tecnicamente precario di criteri bibliometrici fai-da-te. Meglio limitarsi a qualche soglia assoluta destinata ad escludere candidati la cui produzione scientifica non raggiunge la necessaria massa critica. La maturità scientifica non si misura un tanto al kilo e la rincorsa opportunistica può procurare parecchi danni (oltre che possibili ingiustizie).

Bisogna considerare che tra i supermediani non abilitati ci sono quelli giudicati non congruenti col settore.

Compreso. Ma in questo caso forse un indicatore più corretto dell’efficienza del predittore “mediane” potrebbe essere l’odd-ratio, cioè il rapporto (veri positivi+veri negativi)/(falsi positivi+falsi negativi).

In questo caso (48,8+17,8)÷(27,4+6)=1,99. In pratica le mediane “ci azzeccano” due volte meglio che estrarre gli abilitati a caso! Non esaltante.

Anche perché c’è un meccanismo di autoselezione da parte dei candidati.

Ci sono colleghi che, facendo proprio lo spirito di questo post, hanno fatto pervenire ulteriori domande per il Presidente dell’ANVUR, Stefano Fantoni. Ritenendo di fare cosa utile, le riportiamo di seguito.

==================

Prof. Fantoni, lei ha sottolineato che c’è forte correlazione tra abilitazione e superamento delle mediane. Questo dato giustifica l’uso delle mediane solo se diamo per scontato che le commissioni abbiano giudicato con serietà e rigore scientifico i candidati senza farsi minimamente influenzare dalle mediane.

Lei è certo che tutte le commissioni abbiano giudicato con serietà e rigore scientifico le domande dei candidati?

Se non ne è certo, cosa avete fatto per garantire la serietà del processo di abilitazione?

____________________

Prof. Fantoni, se lei è certo che tutte le commissioni hanno giudicato con serietà e rigore scientifico le domande, può spiegare come sia possibile valutare il contributo individuale di un candidato a pubblicazioni con molti co-autori?

In particolare, può spiegare come sia possibile valutare il contributo individuale di candidati che non abbiano mai (o quasi mai) pubblicato lavori a singolo autore o come primo autore o come corresponding author?

____________________

Prof. Fantoni, se lei è certo che tutte le commissioni hanno giudicato con serietà e rigore scientifico le domande, quanto tempo ritiene, in media, necessario per valutare la qualità di una pubblicazione scientifica di un singolo candidato e, in particolare, il contributo individuale del candidato?

Può indicarci quanto tempo hanno usato i commissari, in media, per valutare una singola pubblicazione?

____________________

Prof. Fantoni, la comunità scientifica internazionale è unanime nel ritenere inaffidabile la valutazione dei ricercatori in base a puri indici numerici. Chi e in base a quali studi ha ritenuto che in Italia sia giusto fare il contrario?

____________________

Prof. Fantoni, lei ritiene giusto che nessuno dei tre indici tenga conto del numero dei co-autori?

Come pensa che questa scelta abbia influito, indipendentemente dal valore del ricercatore, sull’abilitazione di ricercatori che hanno un numero medio di co-autori elevato?

Come pensa che questa scelta abbia influito, indipendentemente dal valore del ricercatore, sull’abilitazione di ricercatori che hanno un numero medio di co-autori basso?

____________________

Prof. Fantoni, lei ritiene giusto che siano state considerate le auto-citazioni? Se sì, in che modo crede che le auto-citazioni possano misurare l’impatto scientifico delle pubblicazioni scientifiche?

____________________

Prof. Fantoni, lei ritiene giusto che le mediane siano state calcolate senza tener conto che alcuni ricercatori di un certo settore potrebbero aver pubblicato lavori non attinenti al loro settore scientifico?

Aggiungo altre due domande:

1)Come si è tenuto conto del fatto che i candidati afferenti ad enti di ricerca differenti dalle Università hanno più tempo per fare ricerca di chi invece ha anche impegni accademici (non solo didattica)? Non era il caso di pensate ad una ulteriore normalizzazione?

2) Per i candidati non strutturati quali sono state le mediane di riferimento quando hanno presentato domanda in sottoaree che prevedevono ulteriori suddivisioni con mediane differenti a seconda dei diversi SSD?

@Lucia hai perfettamente ragione, qui in Italia si usa cosi’: si abilitano tre quattro bravi (e poco importa se non li chiamera’ nessuno) e poi a seguire tutti quelli che le “sQuole” vogliono anzi pretendono. Poi naturalmente si alzano gli scudi dicendo che sono passati i migliori…peccato che alle spalle si trovino le solite facce! Chi fa ricerca sul serio e’ meglio che resti fuori da questo paese, chi ci e’ rimasto a lavorare – come me – quasi ogni giorno si danna per essere tornato, l’Italia e’ ancora ferma al paleozoico….

[…] nel 2014 dall’allora presidente dell’Anvur, Stefano Fantoni, nel corso della sua audizione presso la Commissione cultura della Camera. Un ottimismo scosso dagli arresti e dalle interdizioni del settembre 2017, frutto […]