Da Univeritas (24-8-2011)

“La ricerca perde pezzi. Italia maglia nera d’Europa“: ma è una bufala. La Repubblica ha denunciato un clamoroso crollo della produzione scientifica italiana dal 2008 al 2009: meno 20%. Fonte: le analisi di una ricercatrice italiana. In realtà, il crollo è una clamorosa bufala, dovuta all’uso di dati incompleti, che non trova conferma nelle statistiche aggiornate.

Il 22 agosto 2011 è apparso su Repubblica un articolo il cui titolo mi ha fatto saltare sulla sedia:

La fonte della notizia è un articolo scientifico in stampa sulla rivista internazionale Research Policy dal titolo inquietante

Is Italian Science Declining?

Come dichiarato nell’abstract,

The paper analyses the Italian contribution to the world scientific production, its relative citation impact, its international collaborations and scientific productivity compared with the most productive EU countries over the period 1980–2009.

Nell’articolo di Repubblica è riportata un’intervista a uno dei due autori, la ricercatrice Cinzia Daraio dell’Università di Bologna (il secondo autore, H.F. Moed, è olandese) che riassume i principali risultati dell’articolo. Premetto che buona parte dei fatti e dei punti di vista della Daraio sono veri e condivisibili. Ne cito alcuni (le nazioni di riferimento sono Regno Unito, Germania, Francia, Olanda, Svizzera, Spagna):

- Siamo ultimi per numero di ricercatori rispetto alla popolazione

- Siamo ultimi per investimenti pubblici nella ricerca

- I nostri privati non riescono a sostituirsi a Stato, Regioni e Università

- Nelle collaborazioni internazionali siamo penultimi

- Il contributo italiano alle pubblicazioni nel mondo è pari al 3,3%

- C’è una trentennale disattenzione della politica italiana verso la ricerca

Però il piatto forte dell’articolo di Repubblica è la seguente notizia shock:

per la prima volta in trent’anni la produzione scientifica dell’Italia ha smesso di crescere e dà segnali di arretramento … come quota percentuale dell’intera produzione mondiale e in termini assoluti come numero di articoli scientifici pubblicati. … Sul piano quantitativo le pubblicazioni italiane hanno conosciuto un percorso di crescita dal 1980 (erano 9.721) al 2003 (sono diventate 39.728, quattro volte tanto). Nei cinque anni successivi si è proceduto tra depressioni e fiammate fino al 2008: 52.496 articoli italiani resi pubblici nel mondo, un record. L’anno dopo, il 2009 (ultimo dato conosciuto), il crollo: dodicimila pubblicazioni in meno, poco sopra quota 40 mila, bruciata la crescita di cinque stagioni.

Da circa un anno mi interesso di valutazione della produzione scientifica internazionale e non ho mai visto un calo del 20% in un anno della produzione scientifica di una nazione. Come osservato anche da Pietro Greco, una tale “catastrofe” è interpretata da molti come l’esito inevitabile di politiche miopi e fallimentari.

Tuttavia, il dato è così anomalo e in contraddizione con le mie informazioni precedenti che non ho potuto fare a meno di procedere ad una verifica. La fonte dei dati forniti dalla Daraio è il Web of Science (WoS) della Thomson Reuters. Insieme al database di Scopus (Elsevier), il WoS è la fonte standard da cui vengono ricavate le statistiche sulla produzione scientifica delle nazioni. Le due fonti non danno risultati identici e non c’è consenso condiviso su quale considerare più affidabile. Tuttavia, su dati aggregati esiste una forte correlazione tra i risultati forniti da Scopus e WoS. Per fare un esempio la scelta del database non influenza la classifica delle nazioni scientificamente più produttive. L’accesso ad entrambe le basi dati richiede un abbonamento. Per nostra fortuna, esiste un agenzia di “ranking scientifico”, SCImago che elabora dei veri e propri “Country Rankings” basati sui dati di Scopus e li rende liberamente consultabili in rete.

Ho svolto la mia verifica in tre passi.

Primo passo: confrontiamo le fonti

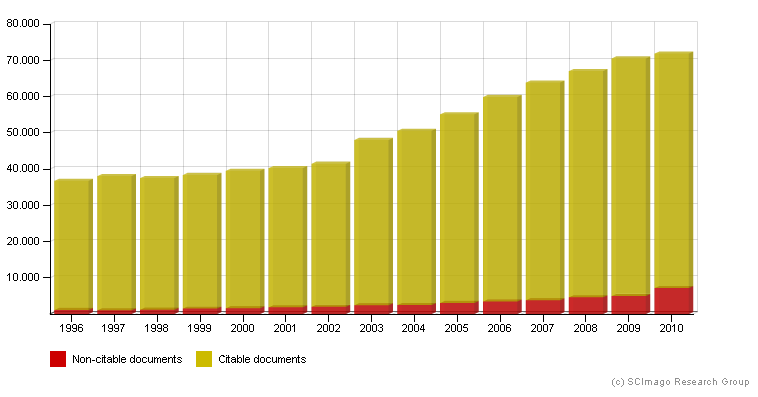

Prima di tutto ho consultato la scheda sui dati della produzione scientifica italiana messi a disposizione da SCImago. Per comodità riporto il grafico dei documenti scientifici dal 1996 al 2010 e la parte della tabella contenente i numeri dei documenti, dei documenti citabili e della percentuale mondiale.

Saltano all’occhio due cose:

- Non c’è alcuna traccia di tracollo nel raffronto tra 2009 e 2008. Sia i documenti che i documenti citabili crescono dal 2008 al 2009, come pure la percentuale di documenti italiani sul totale mondiale che, anzi, raggiunge il massimo di tutti i tempi (3.41%). È interessante notare che sia i documenti che i documenti citabili sono sempre cresciuti dal 1998 in poi, con l’eccezione dei documenti citabili del 2010 (pari a 64.667) che sono inferiori a quelli del 2009 (pari a 65.543). Pur non essendo un tracollo, è forse un primo segno di frenata? Lasciamo per ora in sospeso la questione.

- I numeri forniti da SCImago, la cui fonte è Scopus, sono decisamente maggiori di quelli della Daraio, che provengono da WoS. Per fare un esempio, nell’articolo di Repubblica si parla di 52.496 articoli nel 2008, mentre la tabella di SCimago riporta 62.393 documenti citabili. La discrepanza non è sorprendente in considerazione della diversa copertura dei due database, che però hanno una larga parte di dati in comune. Per quest’ultima ragione, un tracollo superiore al 20% in uno dei due database non può essere completamente invisibile nell’altro.

Il primo passo della verifica evidenzia un’anomalia apparentemente inspiegabile, dato che è per la prima volta che vedo due fonti come WoS e Scopus in stridente contraddizione tra di loro.

Secondo passo: l’origine dell’errore

Considerato l’esito del primo passo, ho voluto verificare il dato della produzione scientifica italiana relativo al 2009, che secondo l’articolo di Repubblica, evidenzierebbe un calo superiore al 20% rispetto all’anno precedente. Usufruendo dell’abbonamento del mio ateneo, mi sono collegato all’advanced search di WoS ed ho eseguito le seguente query

(CU=Italy) AND (PY=2009)

restringendo i risultati ai seguenti tipi di pubblicazione: Article, Proceedings paper, Review , come indicato nella Table 1 dell’articolo di Daraio e Moed. Nella query, ho selezionato tutti i database disponibili, ovvero: Science Citation Index Expanded, Social Sciences Citation Index, Arts & Humanities Citation Index. A sorpresa, il risultato è stato:

2009: 51091 Documenti

Il numero trovato è molto maggiore di quel “poco sopra quota 40 mila” citato da Repubblica. Se il mio risultato è esatto, non si può certo parlare di crollo rispetto al 2008 (52.496 documenti secondo Repubblica), dato che si rimane sopra i 50.000 documenti . Come è possibile? Ho sbagliato a interrogare WoS? Oppure ha sbagliato la Daraio? A mio favore gioca il fatto che un dato “stabile” del 2009 rispetto al 2008 elimina la stridente contraddizione con le statistiche di Scopus che non mostrano nessun tracollo.

Ammettiamo per un momento che il numero fornito da Repubblica sia sbagliato e cerchiamo l’origine dell’errore. Si noti che i database sono continuamente aggiornati. Se si ripetono le stesse queries a distanza di qualche giorno, si ottengono risposte lievemente diverse. L’ipotesi più semplice è che la Daraio abbia interrogato WoS quando i dati del 2009 non erano ancora completamente assestati. In tal modo, avrebbe paragonato i dati più o meno definitivi degli anni precedenti con un risultato solo parziale del 2009. Questa congettura prende forza se si legge quanto scritto a pagina 5-30 del rapporto Science and Engineering Indicators 2010 del National Science Board relativamente all’uso dei dati WoS:

Previous editions reported data based on the year an article entered the database (tape year), not on the year it was published (publication year). NSF analysis has shown that, for the U.S. data, each new tape year file fails to capture from 10% to 11% of articles that will eventually be reported for the most current publication year; for some countries, the discrepancy is much larger. Here, data in the first section only (“S&E Article Output”) are reported by publication year through 2007, which contains virtually complete data for this and prior publication years.

Pertanto:

- C’è un ritardo di registrazione per cui l’ultimo anno disponibile nel database non comprende almeno il 10% degli articoli che a regime risulteranno pubblicati in quell’anno

- Il National Science Board nel suo report del 2010, non usa i dati 2008 e 2009 perché ritiene assestati solo i dati fino al 2007.

Alla luce di ciò, nel 2011 dovremmo ritenere affidabili i dati bibliometrici fino al 2008. È verosimile che anche i dati di Scopus vadano maneggiati con la stessa prudenza e, per tale ragione, l’assai lieve calo dei documenti citabili del 2010 rispetto al 2009 potrebbe scomparire quando i dati del 2010 diverranno definitivi.

Questo secondo passo ci mostra che il dato 2009 citato da Repubblica è fortemente sospetto, probabilmente perché estratto da un database non ancora assestato. Lo scopo del terzo passo sarà validare la congettura sull’origine dell’errore.

Terzo passo: verifica finale

Per convalidare la congettura che la Daraio abbia usato un dato non assestato è importante ricostruire la data in cui ha interrogato il database. In rete è disponibile una versione preliminare dell’articolo la quale è datata 14 dicembre 2010. Figure e tabelle (tranne una, relativa alle spese per ricerca e sviluppo) sono uguali a quelle dell’articolo in stampa su Research Policy. Inoltre, nella versione del dicembre 2010 è citata un’altra precedente versione, presentata in un convegno tenutosi nel luglio 2010. Sembra pertanto che i dati relativi al 2009 siano stati ottenuti tramite interrogazioni eseguite nel 2010, con alta probabilità di ottenere risultati parziali.

La verifica finale viene dal confronto con le statistiche delle altre nazioni. Infatti, l’uso di dati bibliometrici non ancora assestati dovrebbe introdurre un errore sistematico sul conteggio delle pubblicazioni 2009 di tutte le nazioni considerate. Per controllare, basta esaminare la Fig. 9 dell’articolo.

Si vede immediatamente che per tutte le nazioni il numero di pubblicazioni per 1000 abitanti mostra un tracollo del dato 2009 rispetto a quello del 2008. Dato che non ci sono stati improvvisi incrementi della popolazione, il 2009 sarebbe un vero e proprio annus horribilis per tutta la ricerca europea. Fortunatamente, la realtà è diversa. Basta consultare le seguenti schede statistiche di SCImago:

Tutte queste nazioni aumentano la loro produzione scientifica dal 2008 al 2009. Anche le queries da me effettuate su WoS mostrano lo stesso risultato. Infatti, ora che ci troviamo oltre la metà 2011, i dati del 2009 cominciano ad essere un po’ più affidabili. L’Armageddon della scienza europea non è ancora arrivato.

Il terzo passo della mia analisi ha pertanto dimostrato che nella ricerca della Daraio c’è un errore nella raccolta dei dati che riguarda non solo le statistiche italiane, ma anche quelle delle altre nazioni europee considerate. Questo errore crea l’illusione di un crollo generalizzato della produzione scientifica internazionale, di cui non si trova traccia nei dati assestati.

Conclusione

La situazione della scienza (e dell’università) italiana è drammatica perché, a fronte di molti mali e di un cronico sottofinanziamento, è stata oggetto di una campagna denigratoria, a volte grottesca, che ha giustificato ulteriori tagli che la stanno strangolando con grave danno per il futuro del paese. Uno degli aspetti più gravi è stata la diffusione di dati e analisi fuorvianti, tesi a dimostrare che la ricerca italiana non occupa un posto di rilievo nel panorama internazionale. La realtà è diversa e l’articolo di Daraio e Moed ha il merito di ricordare alcune verità fondamentali già note a chi è correttamente informato. Diversa è la questione del “crollo” del 2009. Il presunto tracollo della produzione scientifica italiana è stato da molti interpretato come l’inizio dell’agonia di un malato stroncato dai maltrattamenti e dai salassi di medici incompetenti o peggio. Tuttavia, l’onestà intellettuale impone di dire che il tracollo denunciato nell’articolo di Repubblica è frutto di un’analisi errata. Denunciare gli errori della politica servendosi di notizie prive di fondamento aumenta la confusione e rischia di diventare un boomerang. Le dinamiche della produttività scientifica sono più lente e stiamo ancora sull’onda di una crescita dovuta ai tanti che hanno lavorato e lavorano con dedizione ed entusiasmo. Difficile dire se potrà durare a lungo.