An investigation unmasks the inadequate quality standards applied by some journals requiring article processing charges.

(This article is based on Dell’Anno, Roberto, Caferra, Rocco, Morone, Andrea, 2020. “A “Trojan Horse” in the peer-review process of fee-charging economic journals,” Journal of Informetrics, Elsevier, vol. 14(3).)

According to the slogan that “numbers don’t lie”, the quantitative analysis of research production (i.e. bibliometrics) is becoming an unexceptional element to determine career paths of academics. Several scholars1-2 pointed out the negative consequences of the over-competitiveness in Academia and an uncritical use of bibliometrics. Got to hop on that hamster wheel it is not mandatory but, in the era of bibliometric evaluation, if you don’t take part in the race, someone will check your ranking for you! One of the most relevant side effects of this structural change in the academic profession is the proliferation of misconducts in scientific publishing both from the author’s side (e.g. plagiarism; salami-slicing; impropriety of authorship, falsification of data, etc.) and from the publisher’s side (e.g. editorial favoritism3 and predatory publishing4). Among these dishonorable academic practices, one of the most recent and increasing scientific misconducts is Predatory publishing. It is an exploitative business model, where the publisher requires an article processing charge (APC or publication fee) to cover the costs of peer review administration and management, professional production and dissemination of published papers”. For publishers of “traditional” (No APC) journals, a virtuous circle that incentives a proper peer-review process exists. No APC publishers have an incentive selecting rigorous and competent editors, because they invest journals’ resources on the best manuscripts. The best articles attract more citations than poor works, these quotations increase journal Impact Factor (IF) and, in turn, publishers’ revenue will increase through more library subscriptions and sponsors. Editor’s incentive for a proper screening process for scientific quality is also evident. Journals with higher IF increase the prestige of the editorial board. For APC journals this virtuous circle is broken. Publishers have an incentive to accept anything submitted because more publications mean higher revenue without the third wheel of citations (alias scientific community).

Several scholars raise doubts on the APC model for their too bland peer review process. The peer review process – that it is the only widely accepted method for scientific research validation – indeed may be easily biased by Publisher’s influence on unscrupulous editors permitting an improper or fictitious peer review process.

As Bohannon5 shown by a sting operation, this suspect has found empirical support. He submitted a bogus manuscript to biological, chemical and medical journals requiring APC and his fake article received 157 acceptances on 255 submissions. However, no one has examined the issue systematically and applying an experimental design. We did.

The Experiment – Ulysses at work

We define an experimental research strategy to establish the existence of a cause-and-effect relationship between the APC publishing business model and the inappropriateness of the peer review process. To accomplish this goal, we submit a bait-manuscript to two groups of journals that are equal one to each other in terms of bibliometric characteristics, but different in their business model. Accordingly, we compare journal’s acceptance rate for two groups of journals: the treatment group – including journal requiring publication fee (APC journals) – and the control group – including the journals not requiring publication fees (No APC) -.

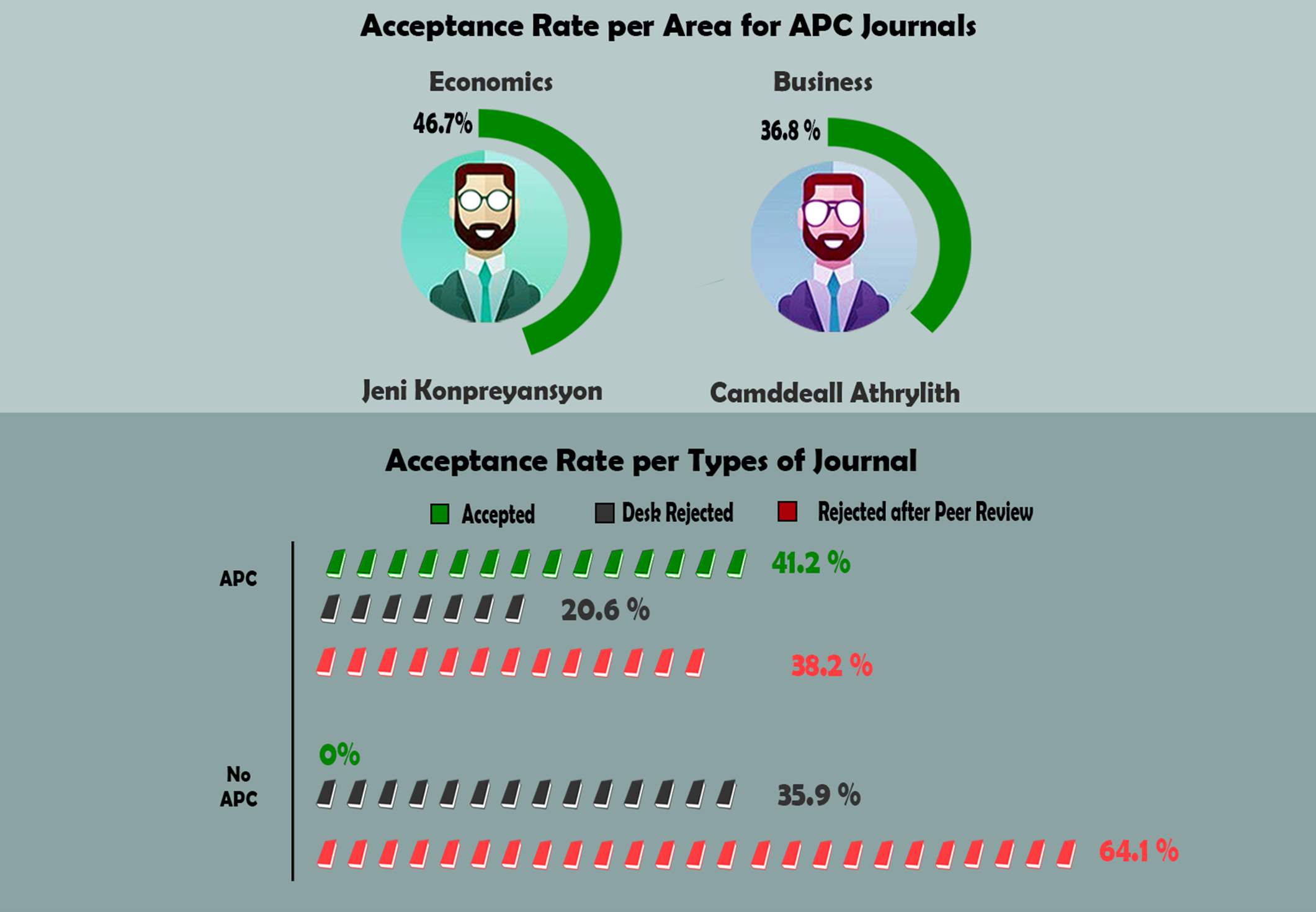

In the first step, we select the treatment group by screening the list of the Italian Research Quality Assessment Exercise (in Italian: VQR) in order to pick – among the 2073 international scientific journals indexed in the areas of “Business” and “Economics” – all the journals which require payment of APC. We found that 52 journals match this condition.

In the second step, we select the control group by choosing 52 journals (like artificial twins), from the same list. This selection consisted to pick, for each journal included in the treatment group, a No APC journal that belongs to the same area (i.e. “Business” or “Economics”); it is indexed in the same bibliometric database (ISI Web of Science and/or Scopus or neither); and had a comparable quality in terms of bibliometric statistics (e.g., IF, h-index, etc.). Once this sample was defined, we submitted a bait manuscript to the editorial offices of these 104 journals.

The analysis of results was based on a sample of 73 journals. It consisted of excluding the 31 journals that sent back the manuscript for “technical” reasons. Specifically, editorial offices do not consider the submission for six types of editorial impediments: some journals share the same editorial office, therefore, it was not possible a multiple submission of the same article; some editorial offices required to modify the bait-manuscript in accordance with the format style guidelines; for other journals, the submissions are no longer allowed or they required to attach personal documents of the submitter or accepting only paper with editor invitation or also to pay a submission fee. Accordingly, this sample counted 34 journals requiring APC and 39 journals not requiring APC.

The Treatment – The Trojan Horse

Following Bohannon’s strategy, we wrote a bait manuscript entitled: “Crime and Economic Growth. An empirical analysis for Germany”. The topic of the study is chosen to fit the greatest possible number of economic journals’ aims.

In order to make multiple communications between (fake) authors and editors easier, we used two false identities for the two areas of economic research (i.e. “Business” and “Economics”). The name chosen was the translation of “Misunderstood Genius” in Welsh (Camddeall Athrylith) and Haitian Creole (Jeni Konpreyansyon) languages. For the affiliations, we have combined the generic “National University of” with the capital cities of the Welsh and Haitian institutions.

The bait had a credible layout for an economic journal article. It included 5 sections (Introduction, Literature review, Methodology, Results and Discussion, Conclusions) and a data appendix.

The hoax was written in Italian and automatically translated to English using Google Translator. The manuscript counted, at least, 70 errors that a skilled peer reviewer should identify and suggest the editor to reject the manuscript. For instance, in addition to the sloppy quality of English, there were: wrong derivatives in the theoretical model; erroneous interpretations of statistical significance of coefficients and goodness of fit statistics; the main conclusions and policy implications were completely reversed compared to the empirical outcomes reported in the manuscript; data sources were fictitious; some invented references; etc.

Data Collection – The Trojan War(s)

The sting operation of Prof. Genius took place in the first semester of 2019.

After excluding for “technical” reasons 31 journals on 104, of the remaining 73 journals, 43 were desk-rejected (i.e. without peer review) because they did not fit with the journal’s aim. Only 20 editors on 34 (58.8%) of the APC journals rejected the paper for the poor quality of the manuscript (see figure 1).

| One referee of APC journal stated: “The paper is well written and I believe this is the best manuscript I have read for [journal name redacted]”. |

In 10 cases the Genius received an invite to revise and resubmit the manuscript. In this circumstance, he re-submitted the original version without any changes but, in the cover letter for the editor and reviewers, he stated: “Dear Editor, please find attached the revised manuscript. Sincerely [author’s name]”. As this second round of peer review process concerns, in 4 cases the re-submitted paper was rejected while for 6 journals, the (false) revised version was accepted for publication. Last but not least, for 8 journals the manuscript was accepted as it was submitted without requiring any revision!

The results of Experiment -The Fall of Troy

Once Trojan horses were in the city, the end of the story depends on the internal rules of the city, out of the metaphor, if the journal follows an APC rather than No APC business model. For journals requiring publication fee, in 14 on 34 cases (41.2%) the paper was accepted. For the traditional journals (No APC) editors always rejected the paper (acceptance rate 0%).

The Moral of the Story

A multifaced picture emerges on academic publishing using the APC business model. On the one hand, we cannot argue that all the APC journals are predatory – indeed a number of these journals applied an appropriate peer review process and rejected the manuscript. On the other hand, there is a (too) large presence of predatory journals among them. We should not throw the baby out with the bathwater; however, an acceptance rate for a bogus manuscript of 42% should be considered as an important warning for the scientific community and policymakers.

The APC business model has shown its inappropriateness to preserve the quality of scientific publishing. The conflict of interests between journals and authors to publish poor researches predictably disappears. Finally, we find that, at least, in the economic area, with the exclusion of ISI web of science and DOAJ (Directory of Open Access Journals), the other famous bibliometric databases and some white lists include, or fail to discover, journals with predatory practices. On 14 journals falling in the trap: 7 (50%) belong to Committee on Publication Ethics list; 4 (29%) are not included in the Beall’s list; 4 (29%) are indexed in IDEAS; 2 (14%) are indexed in Scopus database.

It is important to point out that, although the APC is also the fee requested to publish gold open access (OA), our experiment does not test whether OA journals are predatory. For this reason, an extensive interpretation of our result as supporting the hypothesis that OA is correlated to the inappropriateness of the peer review process is incorrect. Indeed, we find that all the APC journals included in DOAJ rejected the bogus manuscript.

This study has two main policy implications.

The first one deals with the issue of the efficient use of public resources in academic research. The payment of APCs is usually sponsored by scholar’s institution, and for useless articles, it constitutes a clear waste of research funds (e.g. Assistant Prof. Misunderstood Genius had to pay more than 4,900 US dollars as APCs for the 14 accepted manuscripts).

The second implication deals with the effect that predatory journals have on academic recruitment and research institutions’ assessment. Bibliometric statistics are often used in a comparative way. For that reason, if the scientific community, (honest) publishers and public institutions will not seriously join forces to ban predatory journals, in few years, also the use of the bibliometrics, as a complementary assessment criterion of the researchers’ activity, may be seriously questioned.

- Carson, L., et al., Disruptive Science and Technology, 1(4), 183-190 (2013).

- Baccini A, et al. PLoS ONE 14(9) (2019)

- Reingewertz, Y., Lutmar, C., 12(1), 74-86, (2018).

- Beall, J. Nature 489, 179 (2012).

- Bohannon, J. Science, 342, 6154 (2013).

- Fanelli, D. PLoS ONE, 5, 4 (2010)

- Sorokowski, P., et al., Nature, 543, 481 (2017).

Pecunia non olet . Io l’ho sempre sostenuto. vi sono anche figli di ricchi che da anni pubblicano su APC e ora sono PA.

Scusate una cosa, ma leggendo l’articolo originale ho qualche dubbio.

1. usare un sample di 30 journals (Sample 2) su oltre 2700 non mi sembra statisticamente valido.

2. nel settore business alcune delle riviste più note per evitare di avere trippe sottomissioni chiedono il fee di invio

3. Da Tabella 2, l’IF medio dei due campioni è bassino, 0.54 (sempre che interpreti bene, visto che nel testo non è specificato il significato delle righe). Anche SJR medio è molto basso. Ho controllato a volo il valore delle riviste dell’area business e SRJ medio delle prime 100 è sempre sopra a 2. Quelle con SJR 0.23 sono in quartile 3 o 4 (per cui, a meno che non siano molto giovani o molto di nicchia, non le considererei esattamente rappresentative né per APC, né per il no-APC.

4. La maggioranza dei paper accettati provengono dal nord america. Ad esser sincero non ricordo un publisher serio (almeno nel mio dominio) tolto IEEE (ma ne business ha una sola rivista sul Management ed è No-APC) che sia considerabile non predatorio. Ma magari ho poca conoscenza io.

Diciamo che per trarre conclusioni un po’ più solide, avrei ben visto tre sample diversificati per IF, per capire se avere un IF alto impatti o meno (o SJR, se è più semplice). 30 journal mi sembrano pochi. Per finire non si capisce se ci sia una correlazione tra publisher e serietà (vedi il mio punto 4).

BTW, la comunità europea ha appena lanciato la sua piattaforma Open Access (Open Research Europe). Non è questione di denaro, ma di circolazione di conoscenza (soprattutto quella non brevettabile). Di mio posso solo dire che l’Open Access (o su journal completamente OA o pagando la fee al publicher) aiuta in alcuni casi:

– framework metodologici non brevettabili, ma da diffondere in ambiente industriale (per diffondere liberamente l’idea)

– risultati industriali (serve per mettere la “bandierina” prima che te la rubino)

O il mondo è popolato da scemi e profittatori oppure una ripensatina a come evolve il sistema ce la dobbiamo fare.

Comunque grazie agli autori, perché il paper dà comunque spunti molto interessanti.

Ultima nota: sono d’accordo con gli autori del paper che tutti i sistemi, APC o non APC, debbano essere controllati in maniera anonima, ad esempio per evitare il boost di alcuni CV tramite riviste amiche. E per la cronaca la vecchia azienda di cui ero direttore R&D si occupava di Mistery Customer e Mistery Shopping per “mestiere”, per cui condivido appieno comunque lo spirito dell’iniziativa degli autori. Anche controllare come certi publisher “seri” gestiscono il processo sarebbe auspicabile (possono bloccare un paper anche per 3 anni).

Grazie per il commento, provo a rispondere per ordine.

Sul punto 1: le riviste non sono 2714 (tutta l’area 13) ma 2073 ovvero tutte le riviste indicizzate dalla lista VQR per Area 13 per il periodo 2011-2014 nelle due aree “Economics” (1217) e in “Administration and Management” (856). Di queste, richiedono la publication fee 52 (30 Ec + 22 Buss) che includiamo nel gruppo di trattamento). La dimensione campionaria è quindi stata definita individando altre 52 riviste che non richiedono publication fee “bibliometricamente simili” per definire il gruppo di controllo. Da ciò deriva che i dati costituiscono un “campione” rappresentativo del fenomeno, a livello generale delle riviste APC, ma sono la “popolazione” con riferimento all’esercizio VQR per il periodo 2011-2014. In questa seconda accezione quindi non ci dovrebbero essere problemi di rappresentatività dei dati rispetto al fenomeno predatorio nell’esercizio VQR (ma al massimo rispetto alla predatorietà in generale se le liste VQR non rappresentano quest ultima). Per quanto invece riguarda l’inferenza statistica, la dimensione di 30 potrebbe essere “troppo” piccola. Su questo secondo aspetto abbiamo testato questa evenienza. Come vedrà nella tabella 4 “Power test on the Minimum sample size”, per un test di differenza tra medie dei tassi di accettazione delle riviste nei 2 gruppi (trattamento e controllo) e nei due campioni, le dimensioni campionarie non sono mai al di sotto di quella che si potrebbe definire una soglia di rischio accettabile (p-value di 0.9).

Sul punto 2: l’utilizzo delle submission fees è un fenomeno che serve soprattutto a limitare le quantità di submissions ed è tipico delle “top” riviste. Queste riviste hanno un modello di “business” differente, perchè possono utilizzare la loro rendita di posizione (il prestigio, l’alto IF) per fare sia profitti ma anche (o soprattutto) per limitare il lavoro delle redazioni scientifiche. Dal nostro punto di vista, sebbene la submission fee crei una discriminazione tra ricercatori (ad es. in base ai fondi di ricerca) quindi non sia uno strumento ottimale per la “democrazia” della ricerca scientifica, essa non dovrebbe creare incentivi ad accettare articoli di scarsa o nessuna qualità scientifica. Conseguentemente, tali riviste non sono analizzate in questa ricerca. Infine e per completezza non ci risulta che vi siano riviste che richiedano prima la submission fee e dopo anche la publication fee obbligatoria.

Sul punto 3: La Tabella 2 indica la media dei 2 gruppi (trattamento e controllo) nei due campioni 1 e 2. Tutti gli indicatori bibliometrici, IF, SJR sono come ha notato bassi. Lei immagino ha controllato i valori attuali delle riviste, noi invece abbimao utilizzato i valori assegnati nella VQR a quelle riviste perchè riferibili al periodo di classificazione. Negli ultimi 5-10 anni si osserva che gli indici biliometrici delle riviste hanno subito un incremento abbastanza omogeneo come conseguenza della crescita della produzione scientifica. Questo spiegherebbe la differenza si scala tra i suoi IF e quelli riportati nella ricerca.

Sulla sua considerazione circa la non rappresentatività dei nostril gruppi “né per APC, né per il no-AP” personalmente non la condivido con riferimento alle APC. Ritengo che l’impatto bibliometrico delle riviste che richiedono publication fee sia effettivamente, e relativamente, basso.

Condivido invece che il campione di controllo (le riviste senza APC cioè tradizionali “gemelle” a quelle nel gruppo di trattamento) non sia rappresentativo della popolazione delle riviste economiche e/o aziendali no-APC. Ma questo è derivante dal design dell’esperimento. I nostri gruppi di controllo non dovevano essere tali (cioè rappresentare tutte le rivste tradizionali) ma dovevano invece essere “rappresentative” della qualità media (ovvero bassa) delle riviste con APC, solo così infatti le differenze tra medie dei tassi di accettazione poteva essere considerate solo un effetto della distorsione che solo il modello di business (cioè richiedente publication fee) ha sulla scelta se accettare di pubblicare o meno.

Sul punto 4: Spesso i publisher predatori cercano di camuffare la propria “residenza”, indicando nei paesi ritenuti “avanzati” la loro sede editorial come strategia di marketing. Non ci è dato di sapere se poi i flussi economici delle fees o la nazionalità dei proprietari, editori, ecc. corrisponda effettivamente a quella dichiarata dai siti o dalle riviste, ecc. Nel nostro campione esiste quindi un effetto “nord Americano” ma questo potrebbe essere endogeno (cioè fuzionale alla volontà predatoria degli editori). In tutti i casi, il dettaglio delle riviste analizzate è pubblicato nell’appendice online della rivista Journal of Informetrics, qui posso però specificare che questo “American effect” in realtà è un “Canadian effect”.

Grazie Roberto per le precisazioni

Ho effettuato un rapido controllo delle riviste ed un discreto numero sono o non indicizzate in Scimago o con ranking Q3, Q4, che, a meno di una rivista appena nata, non è buon segno. Tra gli editor delle ioen access ne ho visti un paio seri, altri o sconosiuti o noti per non essere molto “attendibili” (almeno nella mia area). In generale l’IF è un primo metro (ripeto che riviste OA con IF 3 o superiore esistono, magari non in Economia, non ho controllato), per cui i risultati che avete ottenuto non mi stupiscono più di tanto. In generale per l’OA (vista anche la maggior citabilità) di mio alzo l’asticella dell’IF per comparare una rivista con una tradizonale.

Ultima nota: l’OA diventerà sempre più importante. La Commissione Europea ha lanciato il progetto interno proprio per pubblicare in OA e con review pubblica i paper risultanti dai progetto Horizon, Oper Research Europe.

Una riflessione penso sia necessaria, per non penalizzare i giovani che lavoreranno nei progetti finanziati.